Il 18 maggio, il Chicago Sun-Times ha pubblicato un articolo dal titolo Summer reading list for 2025. Si tratta di una lista di libri consigliati per l’estate 2025, ma con un piccolo problema: dieci dei quindici titoli non esistono.

Gli autori citati, come Isabel Allende e Percival Everett esistono, ma i titoli e le descrizioni dei libri no. Non esiste, per esempio, nessun romanzo di Allende intitolato “Tidewater Dreams” che unisce realismo magico e attivismo climatico. E Percival Everett non ha mai scritto nulla che si chiami “The Rainmakers”, ambientato in un “futuro prossimo dove la pioggia artificiale è diventata un bene di lusso”.

Un errore umano

Tutto questo è frutto di un errore umano non qualsiasi: l’articolo è stato creato da un’intelligenza artificiale, senza un’adeguata supervisione. Un’AI che, a dirla tutta, non ha brillato per intelligenza: invece di pescare a caso titoli inesistenti e mescolarli con libri veri, non avrebbe fatto prima a scegliere semplicemente quindici titoli realmente pubblicati?

Tale incidente fa riflettere molto dal momento che l’IA è il motore di ricerca più utilizzato, che ha sostituito la classica ricerca su Google; insieme a TikTok per gli appartenenti alla Generazione Zeta (i nati tra il 1995 e il 2010), e a qualche altro chatbot. In questi giorni infatti si parla anche del tramonto della ricerca nel web.

La risposta del Chicago Sun-Times

Messo alle strette sull’accaduto, il Chicago Sun-Times ha risposto: “Stiamo indagando su come questo contenuto sia finito in stampa proprio in questo momento. Non si tratta di un contenuto editoriale e non è stato creato, né approvato dalla redazione del Chicago Sun-Times. Valorizziamo la vostra fiducia nel nostro giornalismo e prendiamo la questione molto seriamente. Seguiranno ulteriori informazioni”.

A fare il colpo giornalistico è stato Jason Koebler, di 404 Media, comunicando che il responsabile del misfatto è tale Marco Buscaglia che, senza troppi giri di parole, ha ammesso di aver lasciato scrivere l’articolo a l’intelligenza artificiale. “A volte uso l’AI come supporto, ma controllo sempre il materiale prima” ha detto a 404. “Questa volta non l’ho fatto e non riesco a credere di non essermene accorto, perché era evidente. Nessuna scusa, è colpa mia al cento per cento e sono molto imbarazzato”.

Il caso analogo di Sports Illustrated

Non è successo soltanto al Chicago Sun-Times. Anche Sports Illustrated ad esempio, nel 2023 è stato sotto accusa per aver utilizzato articoli generati dall’AI con firme e profili di giornalisti inesistenti, come Drew Ortiz e Sora Tanaka. Il caso ha ovviamente suscitato indignazione per la mancanza di trasparenza e per la creazione di identità fittizie.

L’AI nel giornalismo

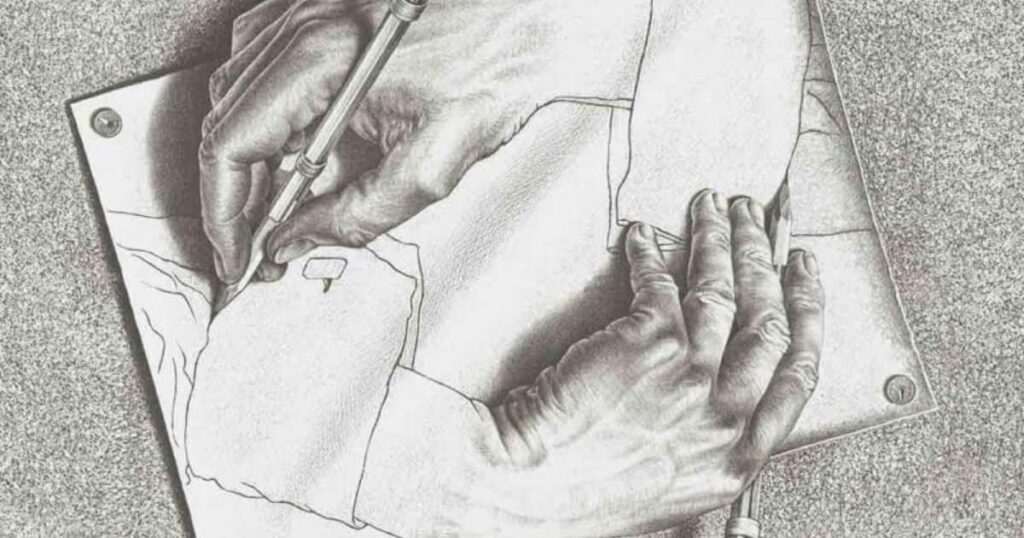

Questo incidente solleva interrogativi più ampi sull’uso dell’intelligenza artificiale nel giornalismo. L’AI dovrebbe essere uno strumento al servizio dell’intelligenza umana, non un sostituto a cui affidarsi ciecamente, principalmente perché è una macchina che non sa distinguere una notizia vera da una fake. Non solo, se da un lato l’AI può ottimizzare la produzione di contenuti, dall’altro rischia di appiattire la creatività umana. L’automazione dei processi editoriali non può che comportare una standardizzazione del pensiero, dove l’originalità lascia spazio alla ripetizione algoritmica. In un’epoca in cui l’autenticità è sempre più apprezzata, l’uso indiscriminato dell’AI non potrebbe che erodere la fiducia del pubblico nei media. Per quanto riguarda la professione del giornalista, non si perderebbe solo un mestiere, perderemmo il dubbio, il contesto e la responsabilità; l’essere umano che interroga la realtà e non solo la elabora. La cosa forse più geniale e significativa è che l’AI è talmente avanzata che è in grado di scrivere articoli che demonizzano l’AI, continuando a guadagnare clic mentre lo fa. Uno scenario così distopico che sembra uscito da un romanzo di George Orwell e chissà se lui ne sarebbe fiero o forse solo molto confuso.